大規模AIワークロードのために最適化された専用インフラストラクチャー

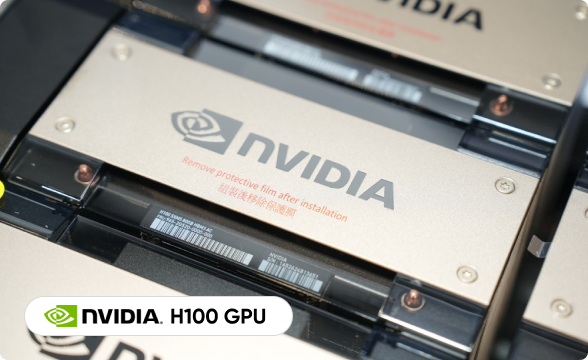

NVIDIA H100・H200

ベアメタル

専用GPUを提供し、完全なコントロールと仮想化オーバーヘッドゼロの環境を実現。高性能なAIトレーニングおよびスケーラブルな推論基盤を支えます。

超高速デプロイメント

高帯域

ネットワーキング

スケーラブルな分散AIワークロードを支えるために設計された、高性能な400Gbps InfiniBandおよびRoCE対応ネットワーク基盤を提供します。

スケーラブルなマルチノードアーキテクチャ

マネージドKubernetesおよび高性能共有ストレージを備えたマルチノード構成により、AIワークロード全体にわたるシームレスなスケーリングを実現します。

今すぐ、貴社用クラスターのご予約を。

専用リソースを備えた、エンタープライズグレードのNVIDIA設計GPUクラスター

NVIDIA HGX H100

NVIDIA HGX H200

FPTのメタルクラウドが選ばれる理由

次世代AIを支えるスケーラブルなインフラストラクチャー

専有GPUリソース

ワークロードは、専有されたGPUメモリおよびコンピュートリソース上で実行されます。

完全なシステムコントロール

サーバーへのフルRootアクセスを提供し、OS、ドライバー、各種構成をAIワークロードに合わせて自由に最適化できます。

高速クラスターネットワーク

共有ストレージ

すべてのGPUノードが単一の共有データセットへリアルタイムでアクセスし、重複や競合、チェックポイントの損失を防ぎます。

ユースケース

高性能・AI駆動ワークロード向け設計

大規模AIモデルをより高速に構築・学習

大規模言語モデルの学習およびファインチューニングに必要なインフラを提供します。

低遅延でスケーラブルなAI推論基盤

制限のない環境で自由に試行と検証

キュー待ちやプラットフォーム制限のない環境で、GPUスタックを完全にコントロールできます。